SFT专攻Pass@k,RL强化Pass@1?

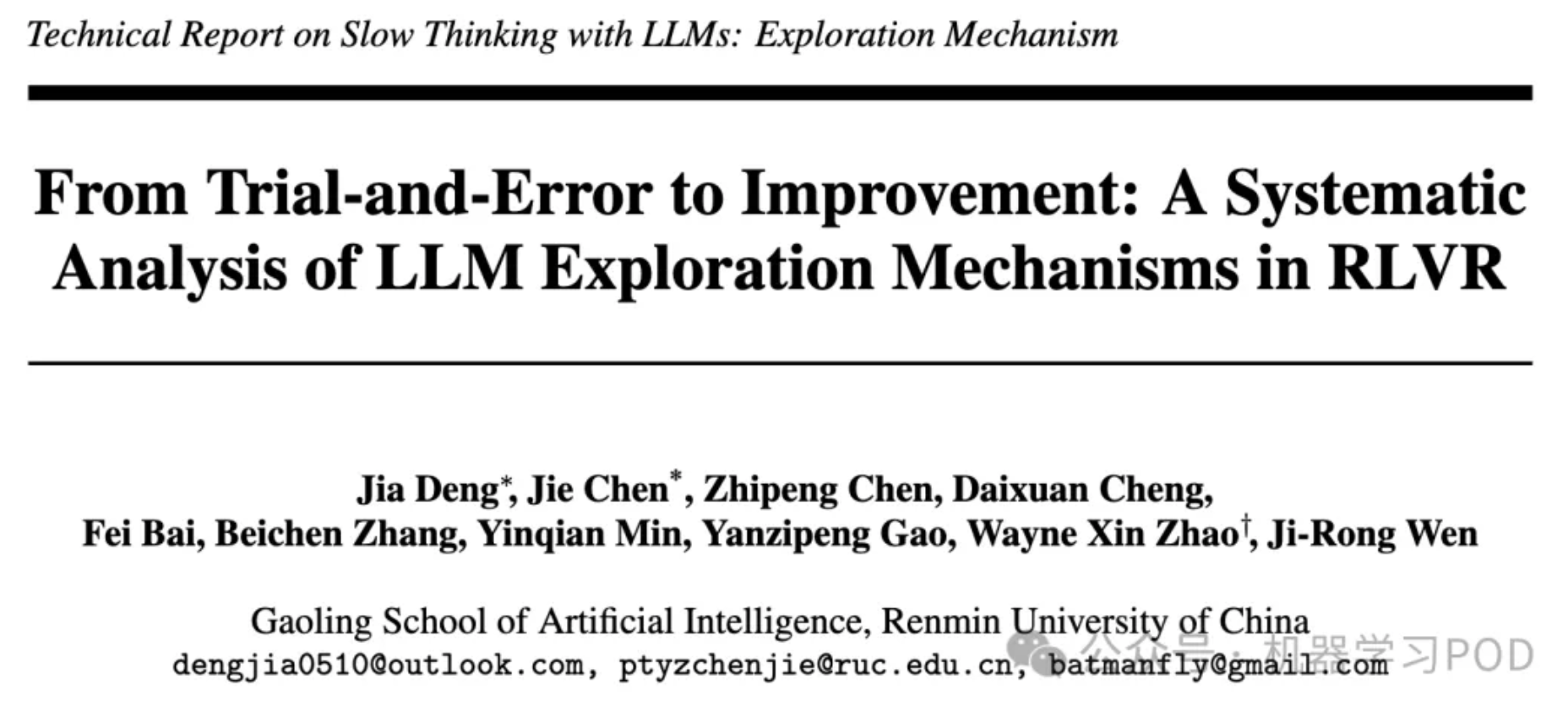

深挖RLVR探索机制:SFT专攻Pass@k,RL强化Pass@1 转自:https://mp.weixin.qq.com/s/QSi580SJ2RFewyFirAe65A 先前的工作已经证明了 RLVR 在实践中的成功,但其背后的根本机制,特别是模型在训练过程中的探索行为,仍有待深入研究。来自中国人民大学高瓴人工智能学院的研究者们发表了一篇题为《From Trial-and-Error to Improvement: A Systematic Analysis of LLM Exploration Mechanisms in RLVR》的技术报告,系统性地研究了RLVR 中的探索机制。 论文题目:From Trial-and-Error to Improvement: A Systematic Analysis of LLM Exploration Mechanisms in RLVR 论文链接:https://arxiv.org/pdf/2508.07534 这篇报告结合了详尽的文献回顾和创新的实证分析,围绕探索空间塑造、熵与性能的相互作用以及强化学习性能优化这三个维度...

Agentic RL

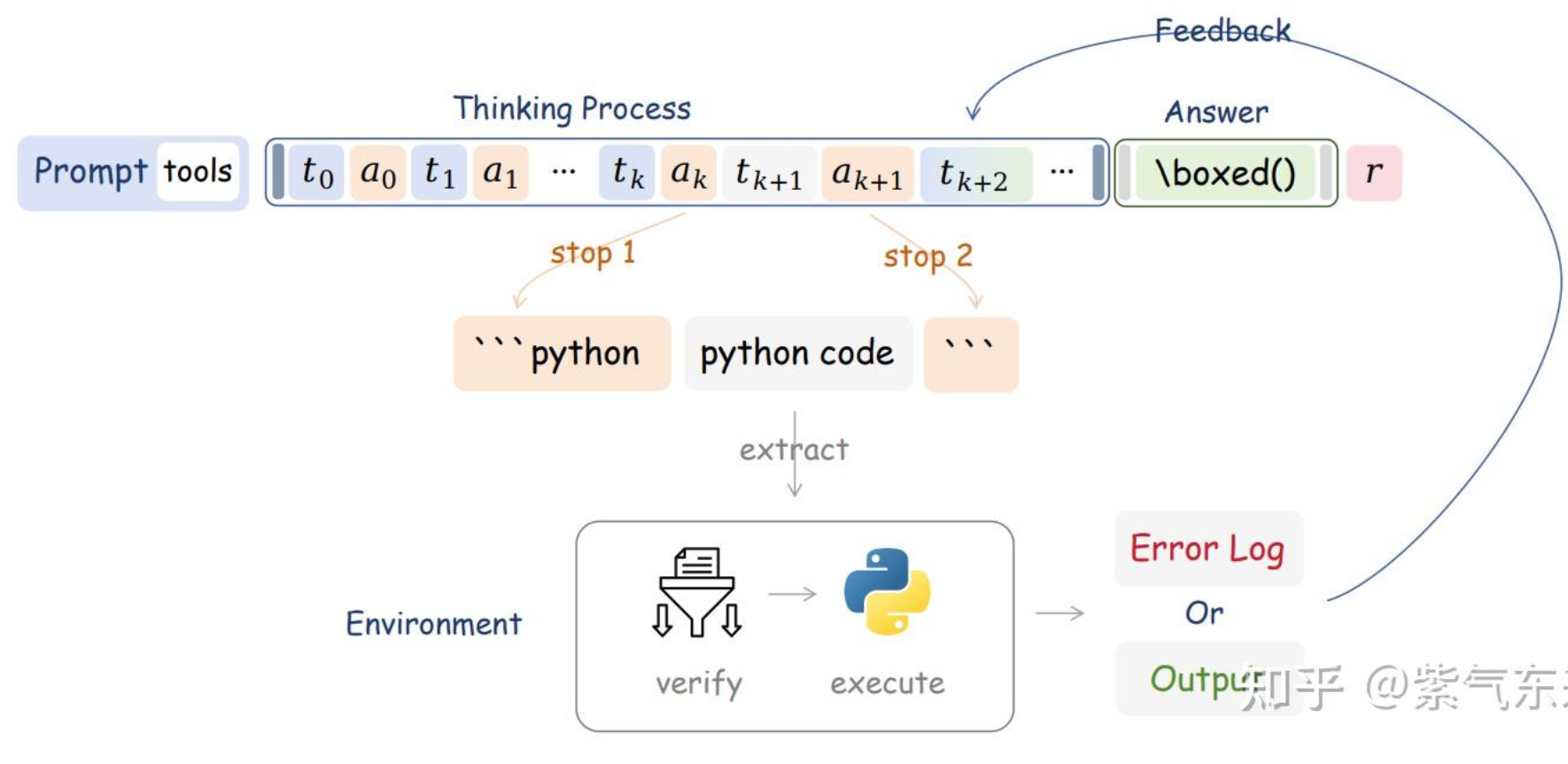

转自:https://zhuanlan.zhihu.com/p/1913905349284591240 通过蒙特卡洛树搜索、过程监督与结果监督、强化学习来提高 LLM 的推理能力,从本质上来说,都是尽可能榨取 LLM 本身的能力,区别可能在于多次尝试、反馈信号、训练方法而已,这类方法可称之为“求诸内”。而由 scaling law 可知,模型的能力是有限的,那么该如何进一步提高LLM在具体问题上的表现呢?近期的答案是,类似 RAG,Multi-Agent 系统,让 LLM 学会使用工具,毕竟人与动物的关键区别也只是“能制造并使用工具”,这种方式则是“求诸外”。那么本篇就以此为中心,重点讨论以下问题: Agentic LLM 的算法逻辑、具体方法与实际表现? RL 如何训练 Agentic LLM,其与 tool using 的 SFT 的差异在哪? Agentic RL 的工程化问题 一、Agentic RL 的算法设计 Agent 和 RL 都并非新鲜事物,而使用 RL 训练基于 LLM 的 agent 则是近期的研究的热点,那么,从算法角度来说,如何理解二者结合的动机、场...

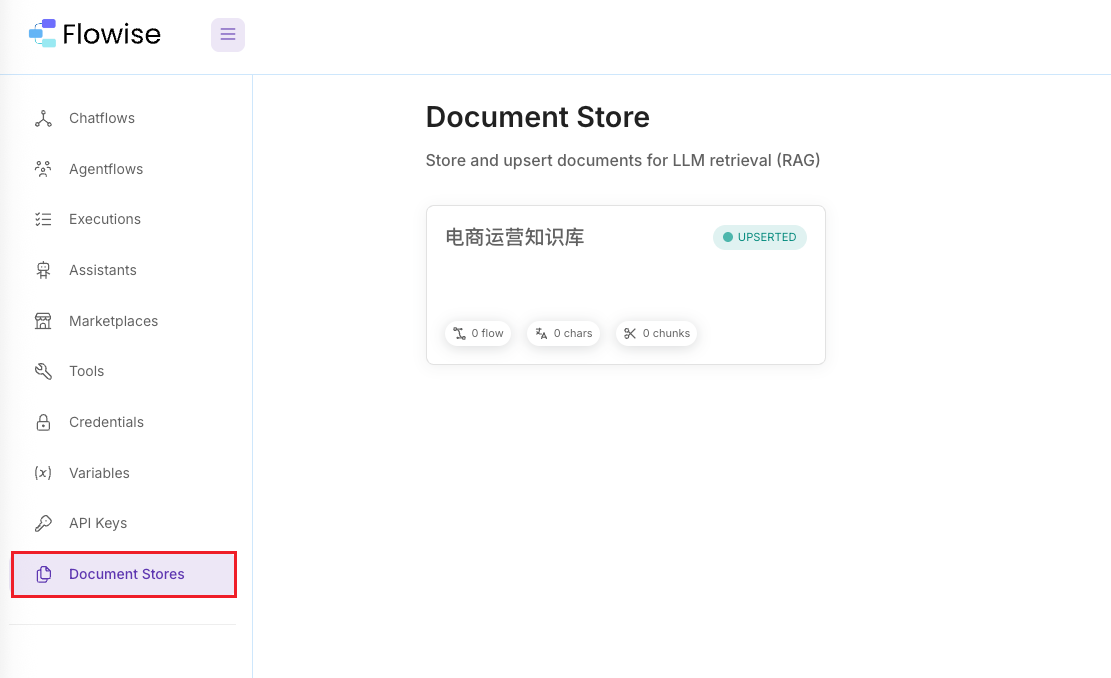

使用 Flowise 构建基于私有知识库的智能客服 Agent(图文教程)

使用 Flowise 构建基于私有知识库的智能客服 Agent(图文教程) https://blog.csdn.net/hejiahao_/article/details/147902607?fromshare=blogdetail&sharetype=blogdetail&sharerId=147902607&sharerefer=PC&sharesource=a1150568956&sharefrom=from_link

UloRL:An Ultra-Long Output Reinforcement Learning Approach for Advancing Large Language Models’ Reasoning Abilities

UloRL:An Ultra-Long Output Reinforcement Learning Approach for Advancing Large Language Models’ Reasoning Abilities 论文链接:https://arxiv.org/pdf/2507.19766 转自:https://zhuanlan.zhihu.com/p/1932380821412638989 得益于Test-time Scaling的成功,大模型的推理能力取得了突破性的进展。为了探索Test-time Scaling的上限,我们尝试通过强化学习来扩展模型输出长度,以提升模型的推理能力。然而,强化学习在处理超长输出时面临两个问题:1) 由于输出长度的长尾分布问题,整体的训练效率低下;2) 超长序列的训练过程中会面临熵崩塌问题。为应对这些挑战,我们对GRPO做了一系列优化,提出了一个名为UloRL的强化学习算法。在Qwen3-30B-A3B的实验表明,通过我们的方法进行强化训练,模型在AIME-2025上由70.9提升到85.1,在BeyondAIME上由50.7提升...

Camel框架

NeurIPS 2023|AI Agents先行者CAMEL:第一个基于大模型的多智能体框架 转自:https://zhuanlan.zhihu.com/p/671093582 AI Agents是当下大模型领域备受关注的话题,用户可以引入多个扮演不同角色的LLM Agents参与到实际的任务中,Agents之间会进行竞争和协作等多种形式的动态交互,进而产生惊人的群体智能效果。本文介绍了来自KAUST研究团队的大模型心智交互CAMEL框架(“骆驼”),CAMEL框架是最早基于ChatGPT的autonomous agents知名项目,目前已被顶级人工智能会议NeurIPS 2023录用。 1777dbe9073c4bcd8ab59365481bcafc.png 论文题目: CAMEL: Communicative Agents for “Mind” Exploration of Large Scale Language Model Society 论文链接: https://ghli.org/camel.pdf 代码链接: https://github.com/camel-a...

极简 Megatron-LM 模型并行切分介绍

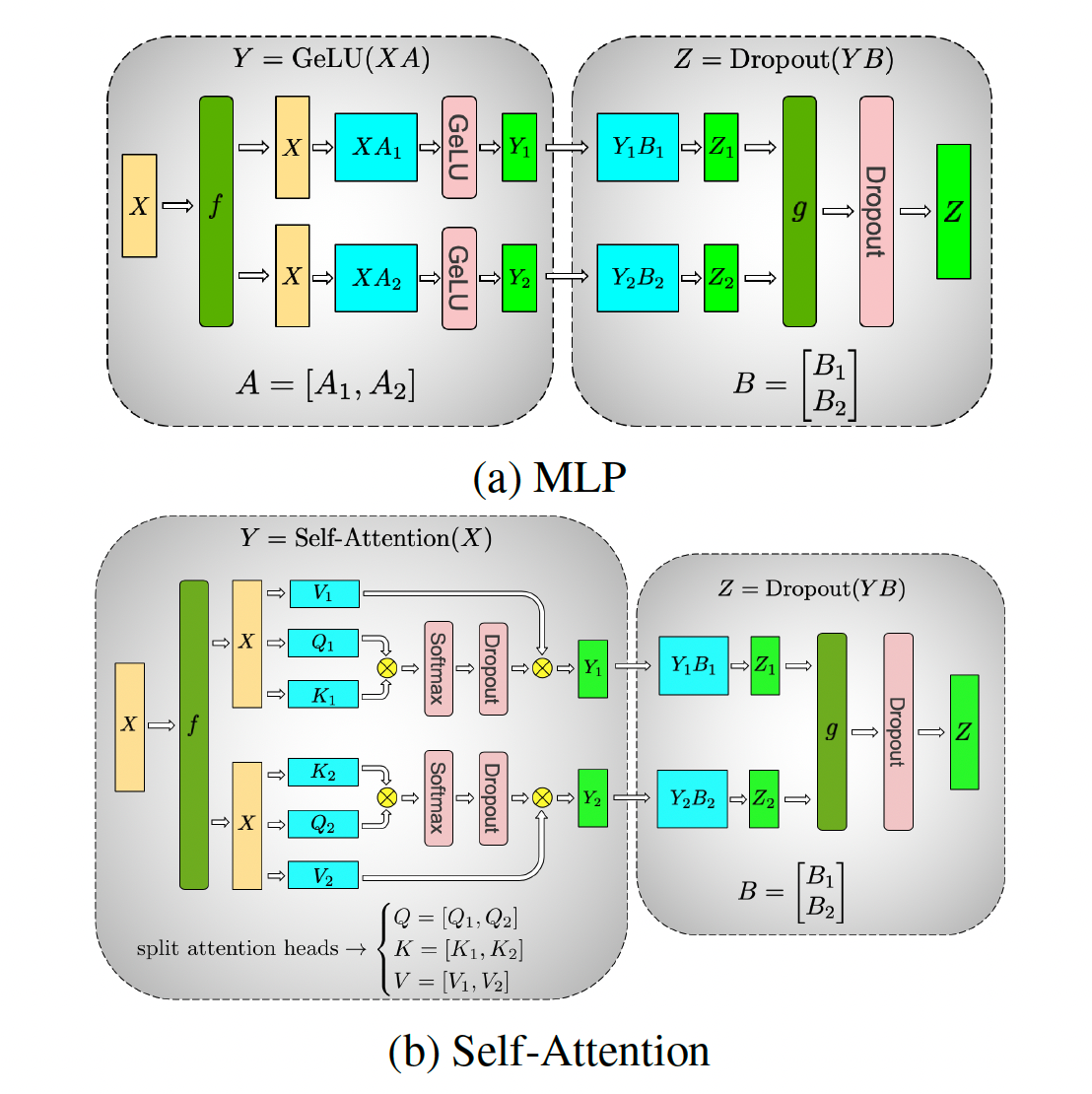

极简 Megatron-LM 模型并行切分介绍 转自:https://zhuanlan.zhihu.com/p/498422407 在大模型流行的年代,我经常需要给同事解释 Megatron-LM 是怎么做的模型并行,自己也经常记不清从头推。而现有大多数的文章都是算法向或者历史向的,信息浓度比较低。为了节省大家的时间,在这里记录一下 Megatron-LM 的切分方式。由于只考虑切分,所以本文忽略 transformer 模型中的各种 elementwise 运算和 layernorm。 下文中,我们规定 b 为 batch size,s 为 sequence length,h 为 hidden size,n 为 num head,p 为切分数,用中括号表示 tensor 形状,例如 [b, s, h] 为常规的 transformer encoder 输入。这种表示方法参考了尤洋老师的 An Efficient 2D Method for Training Super-Large Deep Learning Models。 transformer encoder 结构 tran...

多Agent

多Agent https://www.zhihu.com/question/642650878/answer/1896282773486011813 https://zhuanlan.zhihu.com/p/1908922657027621854 多Agent系统,任务:https://zhuanlan.zhihu.com/p/1909200989090722209 AutoAgents是一个创新的框架,根据不同任务自适应地生成和协调多个专用代理来构建AI团队。AutoAgents通过动态生成多个所需代理并基于生成的专家代理为当前任务规划解决方案,将任务与角色之间的关系相结合。多个专门的代理相互协作以高效地完成任务。该框架还融入了观察者角色,反映指定计划和代理响应,并对其进行改进。该论文在各种基准测试上的实验证明,AutoAgents生成的解决方案比现有的多代理方法更连贯准确,为处理复杂任务提供了新的视角。 地址:https://http://arxiv.org/pdf/2309.17288 代码:https://http://github.com/LinkSoul-AI/Aut...

ray accelerate trainer lightning pytorch

ray、accelerate、trainer、lightning、pytorch 转自:https://www.zhihu.com/question/1926849595331318550/answer/1928049512619968205 作者:CodeCrafter 链接:https://www.zhihu.com/question/1926849595331318550/answer/1939450608894608104 来源:知乎 著作权归作者所有。商业转载请联系作者获得授权,非商业转载请注明出处。 2025 年,纯 PyTorch 是基本功,你必须得会,而且要熟。 它是你的内力,是你理解一切上层框架的基础。 Hugging Face Trainer 是特定领域(尤其是 NLP)的“版本答案”。 如果你就是做微调、做推理,用它,省心省力,快速出活儿。 Lightning 和 Accelerate 是“效率增强器”。 帮你把 PyTorch 代码写得更规范、更工程化,让你从繁琐的样板代码里解放出来,专注于模型本身。 Ray… 这家伙是个“大杀器”,跟前面几个不是一个维度...

xpu_timer

xpu_timer 转自:https://cloud.tencent.com/developer/article/2418684 背景 随着大型模型的参数量从十亿量级跃升至万亿级别,其训练规模的急剧扩张不仅引发了集群成本的显著上涨,还对系统稳定性构成了挑战,尤其是机器故障的频发成为不可忽视的问题。对于大规模分布式训练任务而言,可观测性能力成为了排查故障、优化性能的关键所在。所以从事大型模型训练领域的技术人,都会不可避免地面临以下挑战: 训练过程中,性能可能会因网络、计算瓶颈等多种因素而不稳定,出现波动甚至衰退; 分布式训练是多个节点协同工作的,任一节点发生故障(无论是软件、硬件、网卡或 GPU 问题),整个训练流程均需暂停,严重影响训练效率,而且浪费宝贵的 GPU 资源。 但在实际的大模型训练过程中,这些问题是很难排查的,主要原因如下: 训练过程为同步操作,很难通过整体性能指标来排除此时哪些机器出现问题,一个机器慢可以拖慢整体训练速度; 训练性能变慢往往不是训练逻辑/框架的问题,通常为环境导致,如果没有训练相关的监控数据,打印 timeline 实际上也没有任何作用,并且同...

Qwen3技术报告解读

Qwen3技术报告解读 转自:https://zhuanlan.zhihu.com/p/1905926139756680880 模型架构 Qwen3系列,包括6个Dense模型,分别是Qwen3-0.6B、Qwen3-1.7B、Qwen3-4B、Qwen3-8B、Qwen3-14B和Qwen3-32B;2个MoE模型,分别是Qwen3-30B-A3B和Qwen3-235B-A22B。 Qwen3 Dense模型的架构与Qwen2.5相似,包括GQA、SwiGLU、RoPE以及RMSNorm with pre-normalization。此外,移除了Qwen2中使用的QKV偏置,并在注意力机制中引入了QK-Norm,以确保Qwen3的稳定训练。 Qwen3 MoE模型采用了细粒度专家分割,共有128个专家,激活8个专家。但与Qwen2.5-MoE不同,Qwen3-MoE去除了共享专家。同时,采用了全局批次负载平衡损失。 预训练 预训练数据共36T Tokens,包含119种语言和方言,涉及代码、STEM、推理任务、书籍、合成数据等。 其中,有部分数据是Qwen2.5-VL模型对...