Jetson AGX Orin USB 网络共享配置

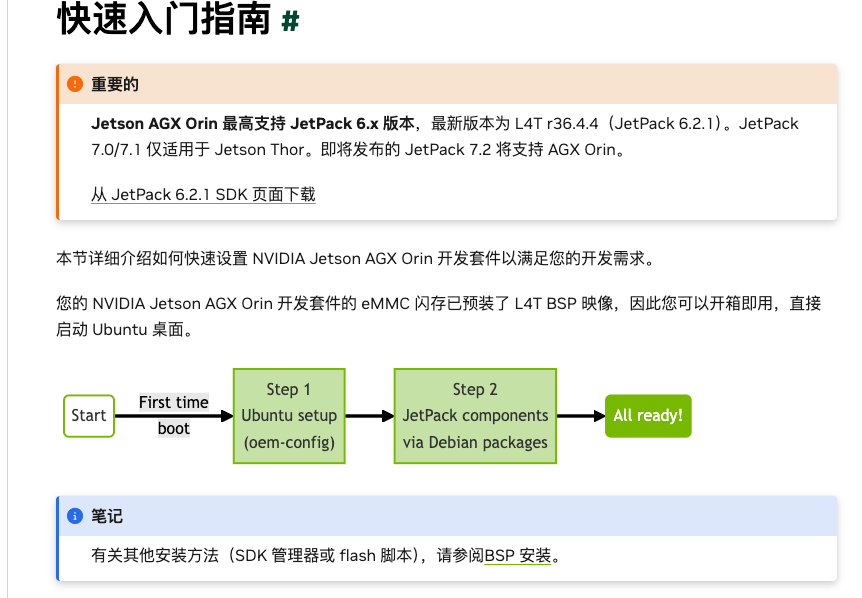

Jetson AGX Orin USB 网络共享配置(通过 Mac 上网) 参考:https://docs.nvidia.com/jetson/agx-orin-devkit/user-guide/quick_start.html 背景 Jetson AGX Orin 通过 Wi-Fi 无法连接路由器(state DOWN,手动配置 IP 也无效),最终改用 USB 网络共享,通过 Mac 上网。 Mac 端配置 用 USB-C/USB-A 线连接 Jetson 和 Mac 系统设置 → 通用 → 共享 → 互联网共享 共享来源:Wi-Fi 共享给:Linux for Tegra 开启互联网共享后,Mac 自动创建 bridge100(192.168.2.1),并将 en7(USB 接口)加入桥接 Jetson 端配置 123456789101112131415# 关键修复:把 usb0 从 l4tbr0 桥上移除# l4tbr0 是 NVIDIA L4T 默认创建的网桥,会干扰 USB 网络通信sudo ip link set usb0 nomaster# 重新通过 ...

QEMU 与 KVM:黄金搭档的前世今生及快速上手指南

QEMU 与 KVM:黄金搭档的前世今生及快速上手指南 在 Linux 虚拟化领域,QEMU 和 KVM 是两个经常被一起提及的名字。很多人习惯说“用 KVM 跑了个虚拟机”,但实际上,这个操作背后往往是 QEMU 和 KVM 的联合工作。二者究竟是不是一个东西?如果不是,它们之间又是怎样配合的?本文不仅会把概念讲清楚,还会手把手带你完成一个可用的 KVM 加速虚拟机实例,让理论落到实践。 一、它们不是一个东西 简单粗暴的结论:QEMU 和 KVM 是完全不同的两个项目,但它们可以完美结合,成为一套高性能虚拟化方案。 QEMU:全能的“模拟大师” QEMU(Quick EMUlator)本身是一个通用的机器模拟器。即便没有任何硬件辅助,它也能通过纯软件的方式模拟出一整台计算机——包括 CPU、内存、硬盘、网卡、显卡等,甚至能够在 x86 的机器上模拟出 ARM 或 RISC-V 的平台。这种纯软件模拟的代价是性能很低,因为每一条目标机指令都要经过软件“翻译”才能在宿主机上执行,通常只用于操作系统内核调试、交叉编译等场景,不适合生产环境。 KVM:专职的“加速引擎” KVM(Ke...

AI Agent 的""安全游乐场":深入理解 Agent 场景下的沙箱技术

AI Agent 的“安全游乐场”:深入理解 Agent 场景下的沙箱技术 随着大语言模型驱动的 AI Agent 不再只是“动嘴”,而是能真实“动手”——运行代码、操控浏览器、调用系统命令——我们面临一个根本矛盾:如何让一个本质上不可预测的模型,在真实环境中安全地执行有副作用的操作? 答案就是沙箱(Sandbox)。它不是一个新鲜词汇,但在 Agent 时代获得了全新的内涵:沙箱不再仅仅是安全防线,更是赋予 Agent “自由探索、安全失败”能力的基石。本文将从必要性、具体形态、关键能力以及实际产品四个维度,为你拆解 Agent 场景下的沙箱技术。 一、为什么 Agent 比任何软件都更需要沙箱? 传统沙箱主要用于防止恶意软件越权,而 Agent 沙箱需要对抗的是一种更微妙的风险:模型输出的不确定性与工具的真实副作用之间的矛盾。 代码的“黑盒性” LLM 生成的代码完全不可预测——可能有逻辑错误、死循环,甚至包含 rm -rf / 这样的毁灭性指令。直接在主系统执行等于把钥匙交给了未知的“创作”。沙箱提供了一次性的、即使毁灭也不心疼的环境。 工具调用的真实副作用 当 ...

云原生沙箱技术深度解析:从 Kata、Firecracker、gVisor、Wasm 到 PodSandbox 的真相

云原生沙箱技术深度解析:从 Kata、Firecracker、gVisor、Wasm 到 PodSandbox 的真相 在容器化席卷数据中心的今天,我们一边享受着 Docker/Kubernetes 带来的敏捷与弹性,一边也时刻被一个幽灵所困扰——容器逃逸。传统容器(runc)基于“共享宿主机内核”的模型,导致一旦攻击者突破某个容器的命名空间限制,整个宿主机就门户大开。这促使业界从两个方向寻求突破:硬件虚拟化 与 软件沙箱。Kata Containers、Firecracker、gVisor、WebAssembly(Wasm)便是其中的四大主角。 然而,这些技术并不仅仅是“另一种运行容器的方法”,它们与 Kubernetes 的 Pod 模型、CRI 接口之间还有着巧妙的联系。本文将从原理、对比、场景,到 Kata 如何巧妙利用 PodSandbox 实现强隔离,为你还原整个技术版图。 一、重新审视:传统容器的“阿喀琉斯之踵” Docker 容器利用 Linux 的 namespace 和 cgroup 实现进程隔离与资源管控,但所有容器共享同一个宿主操作系统内核。这带来两个致...

虚拟机的“外挂神经”:一文搞懂让云主机飞起来的 Virtio 协议

虚拟机的“外挂神经”:一文搞懂让云主机飞起来的 Virtio 协议 在上一篇《虚拟化演进之路》中,我们聊了 VM、KVM 和 MicroVM。我们知道,现代 CPU 很强大,配合硬件虚拟化(Intel VT-x 等),虚拟机执行普通代码的速度几乎和物理机一模一样。 但是,这里有一个巨大的“坑”:I/O 操作(网络和磁盘)。 如果你的虚拟机用的是传统模拟设备(比如模拟的老式 Intel 网卡 e1000 或 IDE 硬盘),你会发现它的网络吞吐量和磁盘 IOPS 惨不忍睹。为什么?因为每一次收发网络包、每一次读写磁盘,虚拟机都要向宿主机“大喊救命”(触发 VM_Exit),让宿主机代劳。这种频繁的上下文切换,直接把 CPU 耗死了。 为了解决这个问题,大牛们发明了一个“作弊神器”——Virtio。 今天,我们就来扒一扒,这个统治了云计算 I/O 性能的核心协议,到底是个什么鬼。 一、Virtio 是什么?不是硬件,是“白皮书” 很多人看到 virtio-net、virtio-blk,会以为这是某种特定的虚拟网卡或虚拟硬盘。 错!Virtio 不是任何实体硬件,它是一套“接口标准”或...

虚拟化演进之路:从 VM 到 KVM,再到为 Serverless 而生的 MicroVM

虚拟化演进之路:从 VM 到 KVM,再到为 Serverless 而生的 MicroVM 在云计算和容器化漫天飞舞的今天,我们每天都在和各种“隔离环境”打交道。无论你是启动了一台云服务器,还是在跑一个 Docker 容器,亦或是写了一个 Serverless 函数,底层都离不开虚拟化技术的支撑。 但在日常交流中,VM(虚拟机)、KVM 和 MicroVM 这三个概念经常被混为一谈。KVM 等于虚拟机吗?MicroVM 是不是就是轻量级容器? 今天,我们就来把这三层“套娃”彻底剥开,从概念到底层原理,聊聊虚拟化技术的演进之路。 一、VM(虚拟机):一切隔离的基石 要理解后面的技术,首先得回到原点:什么是虚拟机(Virtual Machine)? 简单来说,VM 就是在软件层面“模拟出来的一台完整计算机”。它有自己的虚拟 CPU、内存、磁盘和网卡,并且能跑一个完整的操作系统(Guest OS)。 它是怎么工作的? 虚拟化技术(通过 Hypervisor)在物理机(宿主机)的硬件和虚拟机之间加了一层“拦截器”。 CPU与内存虚拟化:让虚拟机以为自己独占了物理资源(现在主要靠硬件辅助...

RDMA技术手册:面向AI场景的深度解析

RDMA技术手册:面向AI场景的深度解析 目录 概述 RDMA原理与架构 2.1 RDMA基本原理 2.2 RDMA网络类型与协议 2.3 RDMA编程模型与Verbs接口 2.4 GPUDirect RDMA技术 RDMA在AI场景的应用实践 3.1 RDMA在分布式训练中的应用 3.2 RDMA在推理服务中的应用 3.3 RDMA在存储与数据IO中的应用 3.4 RDMA在Kubernetes中的集成与实践性能优化与最佳实践 4.1 RDMA性能优化策略 4.2 性能测试与基准工具 4.3 典型问题与调优案例总结与展望 第1章 概述 背景与需求: 随着人工智能(AI)模型规模的爆炸式增长,训练和推理过程对网络通信提出了前所未有的高要求。传统基于TCP/IP的网络通信在延迟和带宽上已难以满足大规模分布式训练的需求。远程直接内存访问(Remote Direct Memory Access,RDMA)技术应运而生,它通过绕过操作系统内核,实现网络接口直接访问应用内存,从而极大降低了通信延迟、提高了吞吐量。在现代AI数据中心中,RDMA已成为加速分布式训练和大规模推理的关键网络技术。...

大规模训练任务与推理服务编排、离线混部及资源调度技术手册

大规模训练任务与推理服务编排、离线混部及资源调度技术手册 目录 概述 原理基础 2.1 Kubernetes调度基础 2.2 大规模训练任务的调度挑战 2.3 推理服务调度的特殊需求 2.4 离线混部的基本原理核心技术与实现 3.1 Kubernetes在训练任务编排中的应用 3.2 Kubernetes在推理服务调度中的应用 3.3 离线混部的实现方式案例与实践 4.1 案例一:基于Kubeflow和Volcano的分布式训练任务编排 4.2 案例二:基于KServe和Triton的推理服务部署与自动扩缩 4.3 案例三:离线混部场景下的资源调度优化总结与展望 第1章 概述 随着人工智能(AI)和深度学习的飞速发展,训练大规模模型和部署高并发推理服务已成为常态。这些工作负载对底层基础设施提出了独特且严苛的要求,远非传统Web应用可比。在训练任务方面,一个深度学习训练作业往往由成百上千个协同工作的子任务组成,需要同时调度大量计算节点,可能涉及GPU等异构资源,并且训练周期长、资源需求波动大。而推理服务则要求低延迟、高吞吐,需要根据请求流量动态扩缩容,并确保服务级别协议(SLA)。...

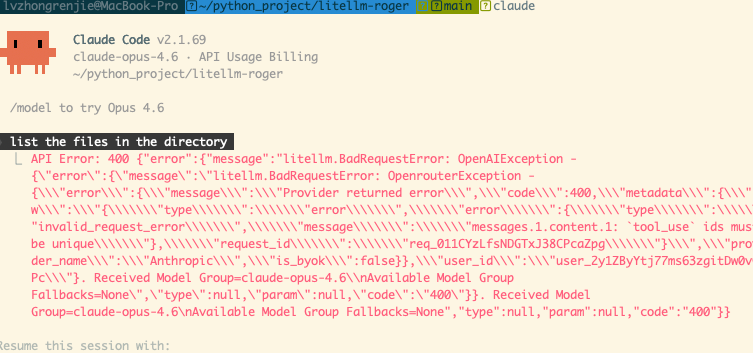

记录一次claude code->litellm->openrouter->claude/gpt模型调用bug的修复

记录一次claude code->litellm->openrouter->claude/gpt模型调用bug的修复 12345678910111213141516171819 lvzhongrenjie@MacBook-Pro ~/python_project/litellm-roger main claude ▐▛███▜▌ Claude Code v2.1.69▝▜█████▛▘ claude-opus-4.6 · API Usage Billing ▘▘ ▝▝ ~/python_project/litellm-roger /model to try Opus 4.6❯ list the files in the directory ⎿ API Error: 400 {"error":{"message":"litellm.BadRequestError: OpenAIException - {\"error\":...

八字命理之贵人篇

八字命理之贵人篇 “贵人”在八字里是一大类“吉神”的统称,核心意思都是:逢凶化吉、遇人提携、办事顺遂。 不同贵人星侧重点不同:有的主官贵,有的主学术,有的主健康、衣食、车马等等。 它们都要在整体五行格局、喜忌的基础上看,不是“带个贵人星就富贵”。 下面按“是什么–有哪些–怎么查–怎么用”系统讲一遍,尽量全面细致。 一、总体概念:贵人是什么? 本质:代表“助力、保护、转机”的吉神 在子平法里,“贵人”属于神煞系统的一类,多是从天干地支组合中取象,象征: 遇事有人帮、逢凶化吉; 易得提携、机会多; 人缘好、能逢凶化吉。 地位:是“象义”,不是断命的唯一依据 古今共识:五行生克制化、格局喜用才是主线,神煞(贵人)只是辅助象义。 同一个贵人星,在不同命局里,可以是: 真贵人:为喜用、无破,助力大; 假贵人:为忌神或被刑冲破害,助力很有限,甚至变成“负担”或“虚名”。 大原则:贵人星要“有用”才贵 喜用神同宫、得生旺、不被冲破:贵人力量大。 为忌神、或落空亡、被刑冲:贵人“打折”,甚至变成“贵人多生病、多事端”。 二、贵人星的大致分类 先给你一个整体框架,方便有个总...