RDMA技术手册:面向AI场景的深度解析

RDMA技术手册:面向AI场景的深度解析

目录

3.4 RDMA在Kubernetes中的集成与实践性能优化与最佳实践

第1章 概述

背景与需求: 随着人工智能(AI)模型规模的爆炸式增长,训练和推理过程对网络通信提出了前所未有的高要求。传统基于TCP/IP的网络通信在延迟和带宽上已难以满足大规模分布式训练的需求。远程直接内存访问(Remote Direct Memory Access,RDMA)技术应运而生,它通过绕过操作系统内核,实现网络接口直接访问应用内存,从而极大降低了通信延迟、提高了吞吐量。在现代AI数据中心中,RDMA已成为加速分布式训练和大规模推理的关键网络技术。

RDMA技术价值: RDMA提供了低延迟、高吞吐的网络通信能力,特别适合于需要频繁、大量数据交换的场景。例如,在多机多卡的分布式训练中,RDMA可以显著减少参数同步和数据传输的延迟,从而加速模型收敛。在大型语言模型(LLM)的推理服务中,RDMA有助于实现快速的多节点协同推理,降低用户响应延迟。此外,RDMA还可应用于分布式存储和高速数据IO场景,通过消除CPU参与数据搬运的瓶颈,提升整体系统效率。

手册定位: 本手册面向AI系统工程师和对RDMA技术感兴趣的开发者,旨在系统讲解RDMA技术原理及其在AI场景下的应用实践。内容涵盖RDMA基础原理、主流网络类型(如InfiniBand与RoCE)、编程模型、在分布式训练和推理中的具体应用,以及性能优化与最佳实践。通过本手册的学习,读者将深入理解RDMA如何赋能AI基础设施,并掌握在实际环境中部署和调优RDMA网络的方法。

第2章 RDMA原理与架构

2.1 RDMA基本原理

核心概念: RDMA是一种让网络接口直接读写应用内存的技术,其核心在于“零拷贝”和“内核旁路”。传统网络通信中,数据需要从应用缓冲区拷贝到内核缓冲区,再由内核协议栈处理并驱动网卡发送;接收端亦然。这涉及多次数据拷贝和内核态/用户态切换,开销较大。RDMA则允许网卡(RNIC)直接与应用内存交互:发送方将数据直接从本地内存“推送”到远程内存,接收方无需CPU参与即可将数据写入预先注册的内存区域。这一过程绕过了操作系统内核,避免了不必要的拷贝,因而实现了极低的延迟和极高的吞吐。

通信模型: RDMA通信建立在队列对(Queue Pair, QP)模型之上。每个RDMA应用程序通过创建QP来定义通信端点,QP包含一个发送队列(SQ)和一个接收队列(RQ)。应用程序通过向SQ提交工作请求(Work Request, WR)来发起操作,例如发送(Send)或RDMA写/读操作。网卡负责执行这些WR,并将完成事件放入完成队列(Completion Queue, CQ)。接收方则通过RQ接收数据或被动等待RDMA操作完成。整个过程由网卡硬件驱动,应用程序通过轮询CQ获取完成通知,从而实现异步、高效的通信。

关键特性: RDMA提供了两种主要的通信模式:两 sided操作和单 sided操作。两 sided操作如Send/Receive类似于传统消息传递,需要接收方预先张贴接收缓冲区。单 sided操作则允许一方直接读写另一方的内存,而无需对方CPU参与,这是RDMA高性能的关键。典型的单 sided操作包括RDMA Read和RDMA Write,它们可以在不通知对方应用的情况下直接传输数据。为了安全地进行单 sided操作,发送方需要知道远程内存的地址和访问密钥(R_key),这通常通过之前的控制消息交换获得。RDMA还支持原子操作,如比较并交换(CAS)和获取并增加(FA),用于实现分布式锁等同步原语。

2.2 RDMA网络类型与协议

InfiniBand网络: InfiniBand(IB)是最早支持RDMA的网络架构,它从物理层到链路层都专为高性能计算设计。IB网络具有低延迟、高带宽的特点,其链路层提供可靠传输和流量控制,支持原生RDMA操作。IB网络要求专门的交换机和线缆,并运行子网管理器(SM)来管理网络拓扑和路径。IB的优点是性能极致,但缺点是成本较高、兼容性相对封闭。

RoCE(RDMA over Converged Ethernet): 随着以太网的普及,业界提出了RoCE协议,将RDMA承载在以太网之上。RoCEv1通过在以太网帧中封装IB传输头,实现二层网络中的RDMA通信。然而,RoCEv1要求二层网络,限制了规模。RoCEv2进一步将IB传输头封装在UDP/IP包中,使其可以在三层IP网络中传输,从而支持更大规模的部署。RoCE网络复用现有以太网交换机,通过优先级流控(PFC)和数据中心桥接(DCB)等技术来提供无损网络环境,保障RDMA通信的可靠性。相比IB,RoCE网络在成本和兼容性上更有优势,但需要精心调优以太网交换机以避免丢包。

iWARP: iWARP是另一种在以太网上实现RDMA的协议,它通过TCP承载RDMA操作。iWARP可运行在标准TCP/IP网络上,无需专门的交换机支持,但其性能(尤其是延迟)通常不及RoCE和InfiniBand,因此在高性能AI场景中应用较少。

网络选择: 在AI数据中心中,InfiniBand和RoCEv2是主流选择。InfiniBand提供极致性能,适合对延迟和带宽要求极高的训练集群;RoCEv2则凭借兼容现有以太网基础设施、支持大规模部署的优势,被许多云服务商和企业采用。实际部署时,需要根据成本、规模和性能需求权衡选择网络类型。例如,Meta等公司已成功在规模庞大的AI训练集群中采用RoCEv2网络,通过优化网络拓扑和拥塞控制,实现了接近InfiniBand的性能。

2.3 RDMA编程模型与Verbs接口

Verbs接口: RDMA编程通过Verbs API进行,这是由IB规范定义的一套抽象接口。在Linux上,RDMA功能通过libibverbs库和内核RDMA子系统实现。开发者使用Verbs API创建QP、CQ、内存区域(Memory Region, MR)等资源,并提交工作请求。Verbs API提供同步和异步两种编程模式,常用的是异步事件驱动模式:应用程序通过事件通道(event channel)等待CQ中的完成事件,然后处理结果。

连接管理: 为了简化RDMA连接的建立,社区引入了**RDMA CM (librdmacm)**库。RDMA CM提供类似Socket的API,支持服务器监听连接请求、客户端发起连接等操作。它封装了底层的QP创建、地址解析和连接建立过程,使开发者无需直接处理复杂的IB传输层细节。例如,服务器端可以调用rdma_create_id创建监听端点,rdma_bind_addr绑定地址,rdma_listen开始监听;客户端则通过rdma_resolve_addr和rdma_resolve_route解析服务器地址并建立连接。连接建立后,RDMA CM会通知应用程序,随后即可通过已连接的QP进行RDMA通信。

示例: 下面是一个使用Verbs和RDMA CM建立连接并发送消息的简化示例:

1 | // 服务器端:创建监听端点并等待连接 |

上述代码展示了RDMA CM简化连接建立的过程。一旦连接建立,双方即可通过Verbs API发送和接收数据。例如,发送方创建一个工作请求(WR)并调用ibv_post_send将消息发送出去;接收方预先通过ibv_post_recv张贴接收缓冲区。当通信完成后,应用程序需要调用ibv_poll_cq从CQ获取完成事件,并进行相应的处理。

高级抽象: 为了进一步简化RDMA编程,业界还开发了诸如**UCX(Unified Communication X)**这样的通信框架。UCX提供了更高层的API,支持多种传输(包括InfiniBand、RoCE、TCP等)和多种编程模型(消息传递、PGAS等)。许多AI框架(如NCCL、MPI实现)底层使用UCX来屏蔽底层网络差异,从而方便地在不同网络上运行。

2.4 GPUDirect RDMA技术

背景: 在AI训练和推理中,GPU是主要计算单元,大量数据需要在GPU之间传输。如果采用传统方式,数据需要先从GPU内存拷贝到主机内存,再通过网卡发送;接收端则相反。这种“GPU-主机-网络”的路径引入了额外的拷贝和延迟。为了解决这一问题,NVIDIA推出了GPUDirect RDMA技术,它允许RDMA网卡直接访问GPU内存,实现GPU与网络之间的零拷贝数据交换。

原理: GPUDirect RDMA利用PCIe总线的一致性特性,将GPU的内存区域映射到网卡的地址空间。发送方GPU可以直接将数据写入网卡的发送缓冲区(或发送队列),接收方网卡可以直接将数据写入GPU内存。整个过程无需CPU介入,也无需将数据拷贝到主机内存,从而极大降低了延迟和CPU负载。

实现: 在Linux上启用GPUDirect RDMA需要内核和驱动支持。NVIDIA提供了nvidia-peermem内核模块,用于管理GPU内存的直通访问。应用程序需要使用CUDA的cuMemAlloc等API分配GPU内存,并通过Verbs的ibv_reg_mr将GPU内存注册为RDMA可访问的内存区域。需要注意的是,由于GPU内存的物理地址可能不连续,且涉及PCIe地址空间,注册GPU内存时需要特别处理。NVIDIA在CUDA 5.0及以后的版本中提供了对GPUDirect RDMA的支持,并在CUDA 6.0中引入了cuPointerSetAttribute等API,用于简化GPU内存的注册流程。

应用: GPUDirect RDMA在多GPU分布式训练中尤为重要。例如,NVIDIA的NCCL库在多机通信时,如果检测到GPUDirect RDMA支持,会优先使用它来直接在GPU之间传输数据,从而加速AllReduce等集合通信。此外,一些高性能存储方案也利用GPUDirect RDMA,将GPU计算结果直接通过网络写入远程存储,或从存储直接读取数据到GPU,实现GPU与存储的高速直通。

第3章 RDMA在AI场景的应用实践

3.1 RDMA在分布式训练中的应用

通信模式: 大规模分布式训练(如数据并行训练)需要在多个工作节点之间频繁同步模型参数。典型的通信模式包括:AllReduce(全局归约,如同步梯度)、AllGather(全局收集,如广播模型参数)、ReduceScatter等集合通信操作。这些操作对网络性能要求极高,因为训练的总时间很大程度上取决于通信开销。

NCCL与RDMA: NVIDIA的NCCL(NVIDIA Collective Communication Library)是分布式训练中使用最广泛的集合通信库之一。NCCL针对GPU集群进行了高度优化,支持在单机内部通过NVLink进行高速通信,在多机之间则利用RDMA网络。NCCL会自动检测集群中的网络拓扑和设备能力,选择最优的通信路径。当检测到GPUDirect RDMA可用时,NCCL会尽量让GPU直接通过网络读写远端GPU内存,从而实现接近线性的多机扩展性能。即使在没有GPUDirect RDMA的情况下,NCCL也可以通过主机内存中转进行RDMA通信,但性能会有所下降。

案例: 在一个使用PyTorch或TensorFlow进行多机多卡训练的场景中,用户通常通过Horovod或框架自带的分布式模块来启动训练。这些框架底层会调用NCCL或MPI来进行跨节点通信。如果底层网络支持RDMA(例如通过RoCE或IB),NCCL将利用RDMA加速参数同步。实践中,开启RDMA往往能显著缩短训练时间。例如,有报告指出,在使用VGG-16模型训练时,启用RDMA网络可将训练速度提升约30%。

网络拓扑与规模: 在大规模训练集群中,网络拓扑设计对通信性能影响巨大。常见的设计是采用胖树(Fat-Tree)或叶脊(Leaf-Spine)架构,确保任意两个节点之间有多条路径、高带宽。对于InfiniBand网络,通常需要部署子网管理器并配置静态路由以优化路径。对于RoCE网络,需要配置PFC和DCB来避免拥塞丢包,并可能需要调整ECN(Explicit Congestion Notification)等拥塞控制策略。随着训练规模从几十GPU扩展到数千GPU,网络拥塞和延迟会成为瓶颈,需要通过多级交换、多路径路由等技术来缓解。

3.2 RDMA在推理服务中的应用

背景: 在大型语言模型(LLM)的推理服务中,多机协同推理(如模型并行、专家混合MoE架构)变得越来越常见。这要求推理服务器之间能够快速传递中间结果或控制信息。RDMA在推理场景中主要用于两个方面:模型并行的数据交换和请求调度与缓存。

模型并行: 当模型过大无法放入单个GPU内存时,需要将模型分割到多GPU甚至多机上。例如,GPT-3等超大模型在推理时,可能需要跨节点交换激活值或中间表示。RDMA可以为这种跨节点通信提供低延迟通道,减少推理延迟。对于MoE架构,每次前向传播可能涉及动态路由,需要将输入数据发送到不同GPU上的专家网络处理。RDMA的快速数据传输可以加速这种动态调度,使得整体推理延迟更接近单机推理。

请求调度与缓存: 在推理服务中,可以使用RDMA来加速请求分发和结果返回。例如,前端调度节点可以将推理请求通过RDMA快速广播到多个后端推理节点,或者将请求参数直接写入推理节点的GPU内存。推理结果也可以通过RDMA快速返回。此外,对于大型模型的KV缓存(如在Transformer推理中缓存的键值对),可以存储在远程节点并通过RDMA按需读取,从而构建分布式的缓存系统,提升推理吞吐。

案例: 有研究提出了一种名为DeepEP的MoE通信库,它利用RDMA来加速专家网络之间的数据交换。NCCL 2.28版本引入了GPU-Initiated Networking(GIN)架构,允许GPU直接发起网络通信。这为MoE等需要细粒度、低延迟通信的推理场景提供了底层支持。通过GIN,GPU内核可以直接调用RDMA操作,将数据发送给远端GPU,而无需CPU介入,从而进一步降低推理延迟。

3.3 RDMA在存储与数据IO中的应用

高性能存储访问: 在AI训练中,数据的读取速度往往成为瓶颈。RDMA可用于构建高速的分布式存储系统,如NVMe over Fabrics(NVMe-oF)和分布式文件系统。通过RDMA,存储服务器可以直接将数据通过网络传输到训练节点的内存或GPU,无需经过存储服务器的CPU。这大大提升了数据加载速度,特别适合需要频繁读取大型数据集的训练场景。

GPU直连存储: NVIDIA的GPUDirect Storage技术进一步将RDMA引入到存储领域。它允许GPU直接通过RDMA从存储设备读取数据,或将数据写入存储。这通过在GPU和存储之间建立直接的数据通道,避免了数据在主机内存的拷贝,从而加速了数据IO。例如,在一个使用GPU训练的深度学习作业中,可以使用GPUDirect Storage直接将存储中的训练样本读入GPU内存,大幅缩短数据加载时间。

高速网络文件系统: 一些并行文件系统(如Lustre、GPFS)和对象存储(如MinIO)已经支持RDMA。通过RDMA,客户端可以更快地读写存储服务器上的数据。对于训练数据集存储在高性能并行文件系统上的场景,启用RDMA可以减少I/O等待时间,提高GPU利用率。

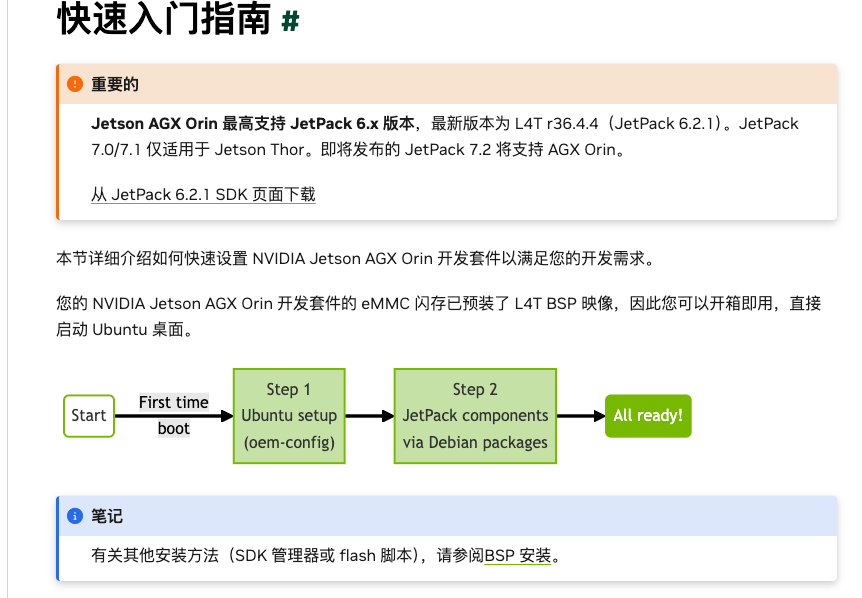

3.4 RDMA在Kubernetes中的集成与实践

Kubernetes网络挑战: Kubernetes默认的网络模型(Pod网络)并不直接支持RDMA。常规的容器网络接口(CNI)插件(如Flannel、Calico)主要针对TCP/IP通信,无法满足RDMA对底层硬件访问的需求。因此,在Kubernetes上运行RDMA工作负载,需要特殊的技术和插件支持。

SR-IOV与设备插件: 一个主流方案是利用SR-IOV(Single Root I/O Virtualization)技术,将物理RDMA网卡虚拟成多个虚拟功能(VF),然后将VF作为设备直通给Pod使用。Kubernetes通过SR-IOV Network Device Plugin来管理这些VF资源。该插件会将VF以扩展资源的形式注册到Kubernetes,Pod可以通过请求这些资源来获得RDMA网卡的使用权。同时,需要配合Multus CNI等多网络插件,为Pod附加SR-IOV网络接口。

RDMA CNI插件: 为了简化在容器中使用RDMA的流程,社区开发了RDMA CNI插件。RDMA CNI通常与SR-IOV CNI配合使用:SR-IOV CNI负责将VF移入Pod的网络命名空间,而RDMA CNI则负责将该VF对应的RDMA设备也移入Pod命名空间,从而实现RDMA设备的隔离。这样,Pod内的应用可以直接使用Verbs API访问RDMA设备,而不会与宿主机的RDMA资源冲突。

实践案例: 在自建的Kubernetes集群上部署RDMA支持,通常需要以下步骤:

- 安装驱动与插件: 在所有节点上安装RDMA网卡驱动(如Mellanox OFED)和Kubernetes设备插件。部署SR-IOV Network Device Plugin,配置资源池(例如

mellanox.com/sriov_rdma)以暴露VF资源。 - 配置网络附件: 使用Multus CNI为集群添加SR-IOV网络附件定义。该定义指定了VF资源池、IPAM等信息,并指定使用

sriov和rdma两个CNI插件链式调用。 - 创建网络对象: 根据使用的网络插件(如 whereabouts 作为IPAM),创建NetworkAttachmentDefinition资源,供Pod引用。

- 运行RDMA Pod: 在Pod的YAML中,通过注解请求SR-IOV网络附件,并在容器内使用RDMA设备进行通信。例如,可以在容器内运行NCCL测试工具,验证多Pod之间的RDMA通信是否正常。

通过上述方式,可以在Kubernetes上运行分布式训练或推理任务,让Pod享有接近裸机的RDMA网络性能。这为在云原生环境中部署高性能AI应用提供了可能。

第4章 性能优化与最佳实践

4.1 RDMA性能优化策略

网络拓扑优化: 在多机训练中,节点之间的网络拓扑会显著影响性能。尽量减少跨交换机的通信、增加路径冗余,可以降低拥塞和延迟。对于InfiniBand网络,可以通过子网管理器配置路由,使通信尽量在本地交换机内部完成。对于RoCE网络,合理设计Spine-Leaf架构,避免单点瓶颈。同时,启用ECN和DCQCN等拥塞控制机制,可以缓解多打一场景下的拥塞。

内存注册与缓存: RDMA要求通信前将内存注册到网卡。频繁的内存注册/注销会带来开销。最佳实践是预先注册大块内存,并重复使用它们。对于GPU内存,可以利用CUDA的流顺序分配和异步注册来减少开销。同时,应避免在通信路径上进行不必要的内存拷贝。

QP和CQ配置: QP的发送/接收队列深度、CQ的大小等参数会影响性能。通常,增大QP深度可以提高流水线并行度,但会占用更多内存。应根据实际负载调整。在高并发场景下,可以考虑使用多个QP并行通信。此外,启用工作请求的内联(inline)发送可以减少小消息的延迟,但会占用更多网卡内存。

多路径与负载均衡: 在大型集群中,启用多路径RDMA可以提高带宽利用率。例如,InfiniBand支持多路径(Multipath)机制,RoCE网络也可以通过ECMP(等价多路径路由)来分散流量。合理配置交换机哈希算法,确保流量均匀分布,避免热点。

GPU通信优化: 对于多GPU通信,应尽量利用NVLink进行节点内通信,因为NVLink带宽远高于网络带宽。在节点间通信时,优先使用GPUDirect RDMA,并确保GPU与网卡之间有足够带宽的PCIe连接。避免在GPU和网卡之间经过多次PCIe交换。例如,将GPU和网卡插入相同的PCIe Root Complex下,可以减少跨域访问延迟。

4.2 性能测试与基准工具

perftest工具集: perftest是Linux RDMA社区提供的标准性能测试工具集,包含多种基准测试程序。常用的工具包括:

常用RDMA性能测试工具:

ib_send_lat/ib_send_bw:测试发送/接收操作的延迟和带宽。ib_write_lat/ib_write_bw:测试RDMA Write操作的延迟和带宽。ib_read_lat/ib_read_bw:测试RDMA Read操作的延迟和带宽。ib_atomic_lat/ib_atomic_bw:测试原子操作的延迟和带宽。

这些工具使用简单,命令行参数丰富。例如,运行ib_write_bw -a可以在两个节点间测试RDMA Write带宽,自动扫描不同消息大小的性能。ib_send_lat -H可以生成延迟直方图,帮助分析延迟分布。

ibping/ibtraceroute: ibping是用于检测RDMA网络连通性的简单工具,类似于IP网络中的ping命令。ibtraceroute则用于追踪RDMA路径。这些工具在诊断网络问题时非常有用。

NCCL Tests: NCCL提供了一套测试程序(如nccl-tests)来评估多机通信性能。这些测试模拟了AllReduce、AllGather等集合通信,并报告带宽和延迟。通过这些测试,可以验证NCCL在RDMA网络上的实际性能,并调优NCCL参数。

性能指标: 在评估RDMA性能时,常用的指标包括:带宽(吞吐量,GB/s或Gb/s)、延迟(通常以微秒计)、消息速率(消息/秒)。不同场景下关注的重点不同:大模型训练更关注带宽,而在线推理更关注延迟。通过基准测试,可以找出性能瓶颈并进行针对性优化。

4.3 典型问题与调优案例

问题1:启用RDMA后性能未达预期。 可能原因包括:网络拓扑不合理,存在拥塞点;内存注册开销大;QP配置不当。解决方法:优化网络拓扑,例如增加交换机互联带宽,调整路由策略;使用内存缓存技术减少注册开销;增大QP深度或启用多QP并行。

问题2:GPU利用率低,通信等待时间长。 这可能是由于网络带宽不足或延迟高导致。检查RDMA链路状态,确保使用了GPUDirect RDMA。如果网络带宽已饱和,考虑增加网络链路或使用更高速的网卡。如果延迟高,检查是否有拥塞或网卡中断开销。

问题3:RoCE网络出现丢包或性能下降。 RoCE要求无损网络环境,如果PFC配置不当或交换机缓冲不足,可能导致丢包。解决方法:确保交换机启用了PFC和DCB,并正确配置了优先级映射。对于大规模RoCE网络,可能需要启用ECN和DCQCN来避免拥塞。

案例: 某研究团队在自建Kubernetes集群上部署了多机RDMA训练环境。初期测试发现,两节点间的RDMA带宽远低于预期。经过排查,发现是由于两个节点分别连接到不同的交换机,跨交换机通信存在瓶颈。调整拓扑,将两个节点连接到同一交换机后,带宽显著提升。该案例说明了网络拓扑对RDMA性能的影响。

最佳实践总结:

- 规划网络拓扑: 根据集群规模选择合适的网络架构,确保高带宽、低延迟和无阻塞。

- 启用无损网络: 对于RoCE网络,务必配置PFC和DCB,避免丢包。

- 利用GPUDirect RDMA: 在GPU通信场景下,尽量使用GPUDirect RDMA,减少主机参与。

- 调优Verbs参数: 根据负载调整QP深度、内联大小等参数,找到性能与资源占用的平衡。

- 使用高效通信库: 优先使用NCCL、UCX等经过优化的通信库,而不是直接使用Verbs API,以简化开发并获得较好性能。

- 定期基准测试: 使用perftest和NCCL Tests等工具定期评估网络性能,及时发现并解决问题。

第5章 总结与展望

总结: RDMA技术通过硬件直接访问内存,实现了低延迟、高吞吐的网络通信,已成为现代AI基础设施中的关键组成部分。本手册系统地介绍了RDMA的基本原理、网络类型、编程模型,以及在分布式训练、推理服务和存储IO等AI场景中的具体应用。我们探讨了如何在Kubernetes云原生环境中集成RDMA,并提供了性能优化和故障排查的最佳实践。通过学习本手册,读者应已掌握RDMA技术的核心概念和实战技巧,能够在实际项目中部署和调优RDMA网络,从而加速AI工作负载的运行。

展望: 随着AI模型规模的持续增长,对网络通信的需求也将不断提升。未来,我们可以预见以下趋势:

- 更高速的网络: 200Gbps甚至400Gbps的InfiniBand和RoCE网络将逐步普及,以满足更大规模模型的通信需求。

- 更紧密的GPU-NIC集成: 新一代GPU和网卡将提供更紧密的耦合,如NVLink网络接口、GPU原生支持RDMA等,进一步降低通信延迟。

- 智能网卡与可编程网络: 智能网卡(如NVIDIA BlueField DPU)将承担更多网络功能,减轻主机CPU负担。同时,可编程交换机和网络设备将允许更灵活的通信模式,如在网络中直接进行梯度聚合等。

- 统一通信框架: UCX等框架将进一步发展,提供更丰富的API和更广泛的设备支持,使开发者能够以统一的方式利用各种高速网络(包括RDMA、CXL等)。

- 容器与边缘: 随着Kubernetes成为AI部署的主流平台,RDMA在容器化环境中的支持将更加完善。同时,在边缘计算场景下,也可能出现对低延迟通信的需求,RDMA技术在边缘的适用性值得关注。

总之,RDMA技术仍在不断演进,与AI的结合也将更加紧密。掌握RDMA技术,对于构建下一代高性能AI系统至关重要。希望本手册能为读者奠定坚实的基础,并在实践中不断探索和创新,推动AI基础设施的发展。