Longformer

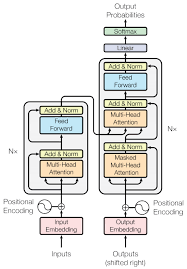

0.参考文献 飞桨PaddlePaddle-源于产业实践的开源深度学习平台www.paddlepaddle.org.cn/?fr=paddleEdu_zhihu 飞桨一站式深度学习在线百科github.com/PaddlePaddle/awesome-DeepLearning/?fr=paddleEdu_zhihu Longformer: The Long-Document Transformerarxiv.org/pdf/2004.05150.pdf https://github.com/PaddlePaddle/PaddleNLPgithub.com/PaddlePaddle/PaddleNLP 1. Longformer的由来 目前基于Transformer的预训练模型在各项NLP任务纷纷取得更好的效果,这些成功的部分原因在于Self-Attention机制,它运行模型能够快速便捷地从整个文本序列中捕获重要信息。然而传统的Self-Attention机制的时空复杂度与文本的序列长度呈平方的关系,这在很大程度上限制了模型的输入不能太长,因此需要将过长的文档进行截断传入模型进行...